jaRijetko je potrebno više od nekoliko pomicanja da biste vidjeli video generiran umjetnom inteligencijom u 2026.

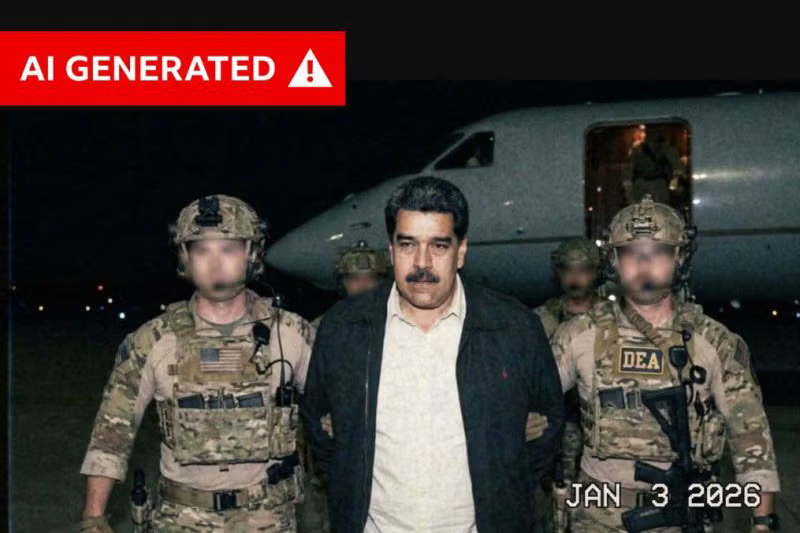

Od zarobljavanja Nicolasa Madura od strane američkih snaga u Venezueli do smrtonosnog ubojstva pripadnika javnosti u Minneapolisu od strane agenata ICE-a, milijuni ljudi gledaju videozapise i slike generirane umjetnom inteligencijom o nekim od najznačajnijih svjetskih vijesti – čineći nemogućim razlučiti što je stvarno ili lažno.

Stručnjaci su upozorili The Independent da se sadržaj generiran umjetnom inteligencijom širi tako brzo da ispunjava informacijsku prazninu prije nego što se pojave činjenice, što dovodi do pojave lažnih narativa dok se novinske kuće trude provjeriti detalje.

“Kako se AI videozapisi nastavljaju poboljšavati, postaje sve teže vjerovati onome što vidimo dok skrolamo društvenim medijima”, kaže Sofia Rubinson, viša urednica Newsguard’s Reality Checka.

“Vizualni znakovi koji su nam nekoć pomogli da uočimo lažni sadržaj više nisu pouzdani, povećavajući rizik od širenja dezinformacija u velikim razmjerima – osobito kada su lažne umjetne inteligencije pojačane dobro poznatim ili provjerenim računima.”

U takvom nereguliranom informacijskom prostoru, nevjerni politički akteri sada mogu tvrditi da su pravi videosnimci lažni.

“Ono što sada vidimo je da će stvarni video početi kružiti i oni će tvrditi da je AI deepfake, što im daje uvjerljivu mogućnost poricanja”, upozorava profesor Alan Jagolinzer, supredsjedatelj Cambridge Disinformation Summita.

“To je zapravo dio opasnosti ovdje, a nedvojbeno je podmuklije od ljudi koji prihvaćaju lažni video.”

Čak je i Bijela kuća nedavno izazvala bijes nakon što je podijelila digitalno izmijenjenu fotografiju aktivista koji je uhićen zbog organiziranja prosvjeda protiv ICE-a u crkvi u Minnesoti. Slika je bila uređena kako bi izgledalo kao da plače.

Analiza stručnjaka za digitalnu forenziku Hanya Farida, profesora na kalifornijskom sveučilištu Berkeley, rekla je da je slika vjerojatno uređena umjetnom inteligencijom.

“Ovo nije prvi put da Bijela kuća dijeli sadržaj manipuliran AI-jem ili generiran AI-jem. Ovaj trend je zabrinjavajući na nekoliko razina. Ne samo da dijele obmanjujući sadržaj, oni sve više otežavaju javnosti da vjeruje svemu što dijele s nama”, rekao je Farid Vijesti CBS-a.

Na pitanje je li korišten drugi softver za uređivanje slika, Trumpova administracija je uputila The Independent na tweet Kaelana Dorra, zamjenika direktora komunikacija Bijele kuće. Jednostavno je pisalo: “Meme će se nastaviti. Hvala vam na pažnji prema ovom pitanju.”

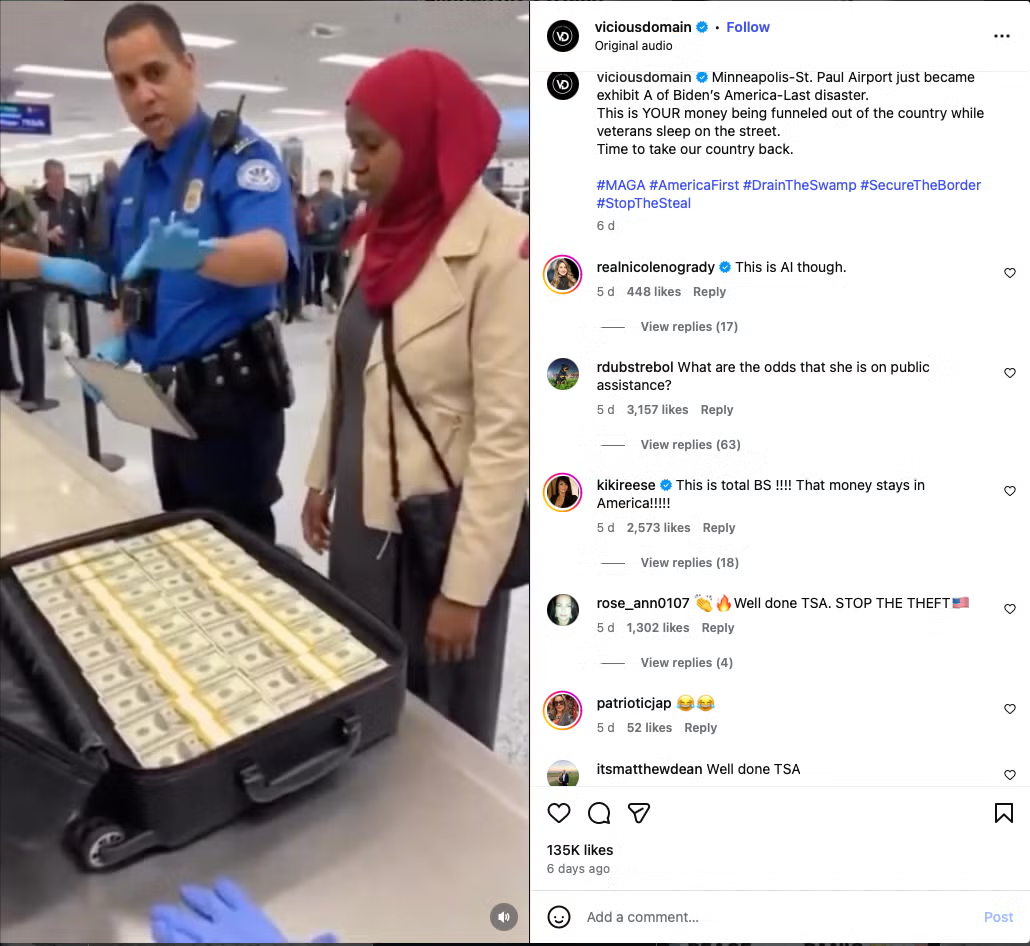

Drugi video koji je generirao AI navodno prikazuje Somalijku uhvaćenu u Minneapolis-St. Zračna luka Paul pokušava prokrijumčariti 800.000 dolara gotovine socijalne pomoći iz zemlje. Čini se da je video, koji su pogledali milijuni ljudi na više platformi, upućivao na optužbe da je somalijska zajednica u Minnesoti sudjelovala u prijevarama širokih razmjera socijalnih usluga, što je potaknulo agente ICE-a da napadnu državu.

Čini se da snimka prikazuje ženu s maramom na glavi koja izgleda bijesno ispred kovčega punog uredno posloženog novca. “Nemate pravo! To je moje vlasništvo, sve”, viče dok osiguranje aerodroma odgovara: “Znam svoja prava.”

Jeremy Carrasco, medijski konzultant specijaliziran za AI medijsku pismenost, rekao je The Independent da je “95 posto siguran” da je isječak generiran korištenjem OpenAI-jeve Sore 2, bez vodenog žiga. Glavni poklon za njega bio je kofer.

“Ovo izgleda kao veličina aktovke. Ovo ne izgleda kao bilo koja veličina prtljage koju bismo imali u Sjedinjenim Državama”, rekao je, dodajući da je imala neobično veliku školjku. “Da je hodala s ovim, gotovina bi se samo istresla uokolo jer bi u kovčegu bilo previše mjesta.”

Komentari ispod videa bili su preplavljeni ljudima koji su se složili s postupcima policajaca, poput: “Bravo TSA. STOP KRAĐI”.

The Independent je kontaktirao Metu za komentar o objavi.

Provjerite izvor

Izvan SAD-a, sadržaj koji je generirao AI također je igrao ulogu u promicanju lažnih narativa o velikim globalnim incidentima uključujući uhićenje Madura, prosvjede u Iranu i nedavni antisemitski teroristički napad na Bondi Beach.

Prema g. Carrascu, najveći korak koji ljudi mogu poduzeti kako bi razlikovali lažni proizvod je jednostavan. Zapitajte se: vjerujem li ovom izvoru?

“Ako ne vjerujete izvoru ili ste procijenili da ne možete, nastavite sa svojim danom”, kaže on. “Postoji puno indikacija. Na primjer, stranica koja samo ponovno objavljuje tonu različitih sranja sa svih strana neće moći raspoznati postavlja li ponovno video AI ili pravi video.

“Morate pogledati izvorni izvor ili ovo konzumirati putem novinske kuće koja je akreditirana i ima odjel za provjeru autentičnosti. Samo provjerite jesu li isključili da to nije pravi video koji je modificiran.”

Pokušaj pronalaska izvornog izvora također vam može omogućiti da dobijete najbolju kvalitetu medija, objašnjava g. Carrasco. Videozapisi koji se ponovno objave ili uploadaju mogu se ponovno povećati pomoću algoritma strojnog učenja koji ih pokušava učiniti većom razlučivošću, što može značiti da savršeno legitimni videozapisi mogu završiti s puno istih kvaliteta kao videozapis generiran umjetnom inteligencijom.

Pogledajte pozadinu

Dok slike generirane umjetnom inteligencijom mogu djelovati prilično uvjerljivo u prvom planu, gospodin Carrasco kaže da je pozadina “često tamo gdje je mnogo tijela pokopano”.

G. Carrasco ističe opovrgnuti video generiran umjetnom inteligencijom za koji se tvrdi da prikazuje Venezuelance kako plaču slaveći uhićenje Madura.

“Mislim da svatko može vidjeti da tip straga isprva zapravo drži zastavu, a onda nakon što ona ode iza njezine glave, on više ne drži zastavu.”

Nakon što pogledate rubove okvira u videozapisima generiranim umjetnom inteligencijom, možete pronaći stvari koje dolaze u scenu i koje nemaju smisla. To uključuje ruke ili promjene crta lica.

Suočavanje s utjecajem sadržaja generiranog umjetnom inteligencijom i njegovim utjecajem na politiku i društvo zahtijevat će “strpljenje i dokaze”, kažu stručnjaci. Ali možemo i sami postavljajući neka osnovna pitanja kritičkog razmišljanja.

“Pokušajte procijeniti, ne samo poruku, već i poticaje iza poruke. Dakle, tko komunicira i što želi?”, kaže profesor Jagolinzer.

“Što im je od toga da pošalju tu poruku? Mislim da ljudi zaboravljaju da kada komuniciramo, imamo poticaje, imamo razlog za komunikaciju. Stoga pokušavam navesti ljude da razmišljaju o tome ‘zašto mi to govore? što je u tome za njih?'”

Razmjer lažnih informacija je “gori od svega što smo vidjeli prije” zbog toga koliko su generativne AI aplikacije lako dostupne, rekao je g. Carrasco.

“Nije samo pitanje kako otkrivamo pojedinačne stvari, već i kako društvo obrađuje ovaj novi val, ovu poplavu lažnih slika i lažnih videa koje gledaju svaki dan.”